El pasado 25 de marzo, Meta y Google fueron hallados responsables en California por generar adicción con el diseño de sus plataformas. Más allá del resultado —un fallo de negligencia y cerca de 6 millones de dólares en daños—, el caso en sí mismo supone un parteaguas en la manera judicial en que se ha tratado y decidido sobre la responsabilidad de los intermediarios de Internet. En esta nota, me concentraré particularmente en este cambio, aunque creo que es igual de importante discutir sobre el rol de las plataformas en garantizar un entorno digital seguro para niños, niñas y adolescentes.

“Las 26 palabras que crearon Internet”… y algo más

En 1996, el Congreso estadounidense aprobó la Ley de Decencia de las Comunicaciones, una norma que buscó modificar la Ley de Telecomunicaciones para prohibir la pornografía. Aunque fue declarada inconstitucional un año después, una parte de la Ley permaneció vigente y ha tenido una relevancia indiscutible por décadas —ameritando pronunciamientos de Trump y Biden sobre la regulación de Internet en EE.UU.—: la Sección 230(c).

Esta disposición fue pensada y aprobada en un contexto muy diferente al actual: un fallo de 1995 contra el sitio Prodigy había establecido que los proveedores de servicios en línea podían ser declarados responsables por las expresiones de sus usuarios, en tanto cumplían un rol editorial. Además de las preocupaciones sobre la libertad de expresión e información, esto suponía un riesgo a nivel de industria, pues desincentivaba la innovación y creación de plataformas abiertas a todos los usuarios.

En respuesta, surge la Sección 230(c), popularizada por Jeff Kosseff como “las 26 palabras que crearon Internet”1. En su primer párrafo (230(c)(1)), la sección establece que los intermediarios no serán responsables por contenidos de terceros2, al señalar que no realizan labor editorial, y ofrece inmunidad a usuarios y proveedores. En consecuencia, ni una gran plataforma ni un pequeño blog personal son responsables por lo que otro usuario comente o publique allí.

Menos comentada, aunque mucho más problemática, es la sección 230(c)(2). Este segundo párrafo extiende la inmunidad de los intermediarios, quienes tampoco serán responsables por la manera en que decidan moderar los contenidos, incluso si dicho contenido está protegido constitucionalmente. En la actualidad, precisamente, el rol de moderación de las plataformas ha dado origen a debates sobre censura privada, debate público y democracia, originando, por ejemplo, la elaboración de las Directrices para la Gobernanza de las Plataformas Digitales de Unesco, proceso que, como Hiperderecho, seguimos en 2023.

En conjunto, ambas partes de la sección 230(c) han tenido un efecto crítico sobre las decisiones comerciales y de producto de las grandes plataformas. Sin duda, en otras latitudes, diversos países tienen su propio régimen de responsabilidad sobre intermediarios (por ejemplo, la Digital Services Act y otras normas de la Unión Europea, el Marco Civil de Internet de Brasil, o, incluso, Tratados de Libre Comercio entre Estados). Sin embargo, considerando que las grandes plataformas tecnológicas surgieron en Silicon Valley —y que incluso las que no lo hicieron se ven afectadas por decisiones en jurisdicción estadounidense—, es imposible hablar del tema sin referirnos a esta norma… o eso pensábamos.

Diseño versus contenido

Por 30 años, la sección 230(c) ha funcionado como un gran escudo para las plataformas. A fin de cuentas, son libres de moderar como mejor prefieran —sea que les motive la rentabilidad, las preferencias de sus comunidades, o ambas—. No obstante, sus alcances se siguen disputando año a año, bajo la mirada atenta del ecosistema de derechos digitales.

Por ejemplo, en 2023, los casos de Gonzalez c. Google y Twitter c. Taamneh buscaban hacer responsables a las plataformas por sus sistemas de recomendación, bajo el argumento de que estaban cumpliendo un rol editorial. El problema es que una interpretación extensiva puede ocasionar que se elimine el principio de no responsabilidad por contenido de terceros. Estos escenarios son peligrosos porque generan incentivos perversos para que las plataformas sobre-eliminen todo tipo de contenido, incluso aquel que no sea ilegal, para evitar ser sancionadas. Por esa razón, organizaciones de la sociedad civil pidieron no afectar la inmunidad que otorga la sección 230. Este criterio fue seguido, finalmente, por la Corte Suprema en sus respectivas sentencias.

La discusión sobre responsabilidad de intermediarios y libertad de expresión es tan delicada, que las plataformas suelen salir bien libradas del problema bajo la sección 230(c) —considerando, además, la extensa tradición de la Primera Enmienda en el derecho constitucional norteamericano—. La decisión del caso K.G.M. c. Meta y Google es particular, precisamente, porque no ha sido argumentada con elementos de esta norma. Se aleja del contenido para atender al diseño.

La demandante, K.G.M. (20 años), señaló que empezó a utilizar Instagram y Youtube3 antes de los 10 años, y alegó que múltiples características de diseño de ambas plataformas le generaron adicción y afectaron su salud mental: motores de recomendación algorítmicos, scroll infinito, reproducción automática de contenido multimedia, notificaciones “recompensa”, filtros de belleza y otras funcionalidades. Sin embargo, lejos de inscribir el algoritmo de recomendación en el marco de la responsabilidad de intermediarios como es entendida por la sección 230 —que implicaría que se trate como una decisión de moderación libre de la plataforma—, el litigio se enfoca en la responsabilidad por producto.

Como explica la profesora Rossini, la estrategia de la demandante no se enfocó en el daño que le ocasionaba el contenido de terceros recomendado por las plataformas, sino en las decisiones de ingeniería y diseño de las mismas. En ese sentido, a Meta y Google les corresponden las mismas obligaciones que a cualquier otro proveedor —digital o no— que pone un producto en el mercado, siendo pasibles de incurrir en negligencia y responsabilidad objetiva por los daños que ocasionen.

Desde luego, la defensa de Meta invocó la sección 230 para argumentar que la plataforma no puede ser responsabilizada como editora por los daños que causaron los contenidos de terceros. Incluso, Meta sostuvo que las características de diseño, como el scroll infinito, simplemente llevan a los usuarios a consumir contenido, intentando que el debate jurídico siempre vuelva a este ámbito para poder emplear la sección 230(c). Sin embargo, la jueza del Tribunal Superior de California decidió que el caso ameritaba un juicio con jurado, dado que las decisiones de diseño no son una simple publicación de contenido de terceros, sino una conducta propia de la empresa.

La evidencia

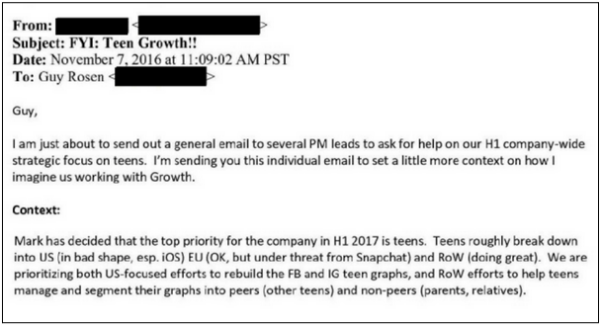

Para la decisión del jurado, han sido claves dos elementos. Por un lado, los Facebook Papers, filtrados en 2021, revelaron que existían documentos internos que acreditaban los daños que generaba la plataforma y que alertaban sobre los riesgos de las decisiones de diseño, lo cual demuestra que la compañía conocía del impacto negativo de Instagram en sus usuarios adolescentes. Por otro lado, dentro del juicio, Meta exhibió documentos internos que no habían sido publicitados previamente —por lo cual el abogado de la demandante también hizo énfasis en la falta de transparencia de la plataforma—. En estos intercambios, los empleados admiten, entre otros, que “la prioridad de la compañía son los adolescentes”, y que “es crucial involucrar a la mayor cantidad de adolescentes de una misma área o escuela”. (La evidencia sobre Meta y también sobre las otras compañías puede encontrarse aquí, gracias a la curación de The Tech Oversight Project).

Anexo 44: Correo con el texto “Mark has decided that the top priority for the company is teens”.

Estos documentos demostrarían que, dentro de la empresa, se conocía la posibilidad de estos daños —que coinciden con los que K.G.M. señaló haber sufrido—, y aún así no se tomaron acciones para evitarlos. Al contrario, el modelo de negocio continuó enfocado en conseguir la atención de los adolescentes. Por tal razón, Meta habría faltado a su deber de cuidado razonable al diseñar su producto.

¿Qué esperar luego?

El caso tiene diversas implicancias. En primer lugar, al ser el primer caso de responsabilidad de plataformas en relación con niños, niñas y adolescentes en llegar a un jurado, se esperan muchas otras demandas. El juicio es un testeo o caso de prueba (bellwether trial) vinculado a otras 2000 demandas pendientes, además de los casos que impulsarán más de 40 fiscales generales.

Por supuesto, no solo toca esperar a que se publique la sentencia escrita, sino también a la apelación de Meta y Google (cuando menos, Meta ya adelantó que apelará). Sin embargo, es evidente que las reglas del juego ya están cambiando: por ejemplo, en Nuevo México se decidió otro caso contra Meta a partir de la legislación de protección del consumidor. Aunque de momento estas plataformas seguirán funcionando como siempre, es claro que nuevas teorías jurídicas están entrando en el terreno de la responsabilidad de intermediarios. Esto podría tener impactos en futuros desarrollos, considerando, nuevamente, que se trata de compañías basadas en EE. UU.

En Latinoamérica, la discusión sobre responsabilidad de intermediarios también está muy activa. Recientemente, el Tribunal Supremo de Brasil declaró inconstitucional el artículo 19 del Marco Civil de Internet, de modo que ahora las plataformas podrían ser responsables cuando no eliminen contenido, incluso sin contar con orden judicial previa. Aunque no ha habido litigios estratégicos que responsabilicen a las plataformas por los daños que causen a partir de sus diseños, el tema ya ha despertado interés legislativo (por ejemplo, con la aprobación del ECA Digital en 2025).

Por otro lado, es interesante analizar cómo este acercamiento puede interactuar con legislaciones nacionales en materia de IA. Por ejemplo, en Perú, el texto del Reglamento de IA, fuertemente influenciado por la Ley europea, considera como uso prohibido “Influir de manera engañosa o manipulativa en la toma de decisiones de las personas, en especial cuando: usen técnicas subliminales o deliberadamente engañosas o el aprovechamiento de vulnerabilidades, con el objetivo de afectar la capacidad de decisión de una persona de manera consciente e informada; se aproveche de vulnerabilidades cognitivas, emocionales o socioeconómicas de personas o grupos poblacionales específicos con el fin de modificar su comportamiento de manera sustancial; y, se induzca a error o manipule información mediante un sistemas basado en IA, para afectar la autonomía de decisión de las personas” (énfasis añadido).

Si se demuestra que los algoritmos de recomendación están diseñados para generar adicción, esto podría ser una afrenta a la autonomía que el artículo 23.1.a. del Reglamento busca preservar. La pregunta es cómo hacer este análisis sin afectar la circulación de contenido. Antes que censurar, es importante fortalecer medidas de transparencia, como hemos exigido desde la sociedad civil latinoamericana, y como establece también la propia legislación en materia de transparencia algorítmica. Es necesario un debate maduro sobre regulación de los procesos, y no de los contenidos, a fin de devolverle el control a los usuarios. Esto es particularmente urgente en nuestros países, donde no existen mecanismos como el discovery anglosajón, que permite la exhibición de pruebas antes del juicio.

¿Gato por liebre?

Este es un escenario que requiere mucha cautela, porque viene aparejado con otras medidas. Por ejemplo, en la segunda fase del caso de Nuevo México, el fiscal general Torrez pedirá cambios en la plataforma, incluyendo la verificación real de edad. Esto supone un riesgo importante para los derechos fundamentales, incluyendo el derecho a la privacidad, lo que coloca en particular riesgo a las personas defensoras de derechos humanos y otros grupos en situación de vulnerabilidad. Sin embargo, tendencias y decisiones previas, tanto en EE. UU. como en otras jurisdicciones, alertan de la proximidad de este peligro.

Esto no es ajeno al Perú: en los dos últimos años se han presentado más de diez proyectos relacionados con NNA y plataformas. Por ejemplo, el congresista Málaga propuso el Proyecto de Ley 10880/2024-CR. Aunque el texto contenía previsiones relacionadas con estas decisiones de diseño (scroll infinito, reproducción automática, entre otros), también proponía medidas como la identificación biométrica, el bloqueo de VPN o la creación de registro de celulares de NNA. Como Hiperderecho, nos hemos opuesto a estas propuestas, en tanto afectan gravemente otros derechos. Lamentablemente, como sucede en cuestiones relacionadas con la igualdad de género, el discurso de protección de NNA se está convirtiendo en la puerta de entrada para intervenciones regulatorias que habilitan censura, vigilancia y restricciones desproporcionadas a la privacidad.

El rol de las plataformas

Aunque no ha sido el foco principal de esta nota, no quiero dejar de resaltar que los derechos de los niños, niñas y adolescentes deben respetarse, protegerse y ser plenamente efectivos en el entorno digital. Esto ha sido señalado por el Comité de los Derechos del Niño en 2021, a través de la Observación General 25 (CRC/C/GC/25).

Muchas de las recomendaciones y principios de la OG-25 son imposibles de concretar sin colaboración con las plataformas. En ese sentido, es crítico reflexionar sobre su rol y responsabilidad, mientras construimos una regulación respetuosa de la libertad de expresión y la privacidad en línea que garantice un entorno democrático y seguro para infancias y adolescencias. Una Internet Segura requiere de un diálogo multiactor que se centre en los derechos humanos.

Recientemente, Hiperderecho y otras diez organizaciones publicamos un pronunciamiento sobre el tema. ¿Te sumas?

Directora de Investigación

“No provider or user of an interactive computer service shall be treated as the publisher or speaker of any information provided by another information content provider”.↩

Este principio también está inscrito en la tradición interamericana, y ha sido, a su vez, reconocido en la Declaración Conjunta sobre Libertad de Expresión e Internet.↩

También demandó a Snapchat y Tiktok, pero ambas realizaron acuerdos extrajudiciales previos.↩